生体医療分野における自然言語処理の10種競技

ACL 2019より以下の論文を紹介。

この論文では、生体医療分野の自然言語処理におけるベンチマークの提案とベンチマークに対する転移学習性能の評価を行っている。最近の自然言語処理ではモデルの総合的な性能を評価するためにGLUEというベンチマークが使われる。GLUEには文類似度や推論といったタスクのデータセットが含まれ、これらを使ってモデルの総合的な性能のスコアを算出する。この論文で提案しているのはその生体医療版とでも言うべきベンチマーク(BLUE)で、5つのタスクと10のデータセットが含まれる。BERTを用いたモデルを使って性能を測定したところ最高性能となった。

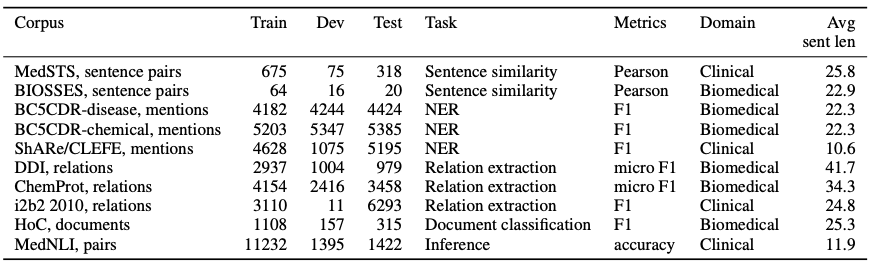

作成したベンチマークであるBLUEには5つのタスクと10のデータセットが含まれる。以下の表に全体像を示す。タスクとしては、文類似度(Sentence similarity)、固有表現認識(NER)、関係抽出(Relation extraction)、文書分類(Document classification)、推論(Inference)の5つとなっている。

文類似度タスクは、文のペアが与えられたときにその類似度を予測するタスクとなっている。学習用データセットの類似度は人間がラベル付けしており、データセットにもよるが0から5くらいの値が使われている。この数字が高いほど類似性が高いことを示す。この人間が付けた類似度とモデルが予測した類似度の相関によって性能が評価される。イメージを掴むために、以下に例を示した。

| 類似度 | 文1 | 文2 |

|---|---|---|

| 5.0 | 東京 | 東京 |

| 5.0 | 太郎と花子は友達だ | 太郎と花子は友人だ |

| 0.0 | お化け屋敷怖い | ラーメンが好き |

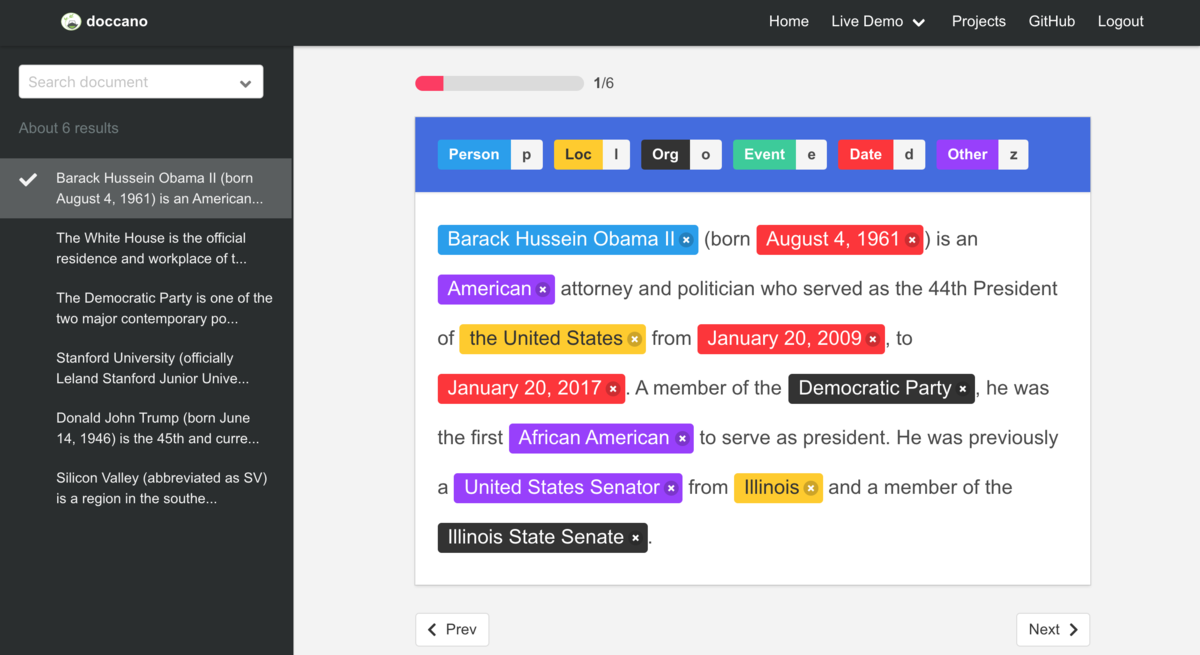

固有表現認識は、テキスト中で固有表現が出現する位置を特定し、人名や地名などの固有表現タイプを付与するタスクのことを指している。一般的には人名や地名、組織名といったタイプがよく使われているが、生体医療分野の場合は化学物質名や病気名といったタイプが使われることになる。以下に固有表現認識の例を示した。

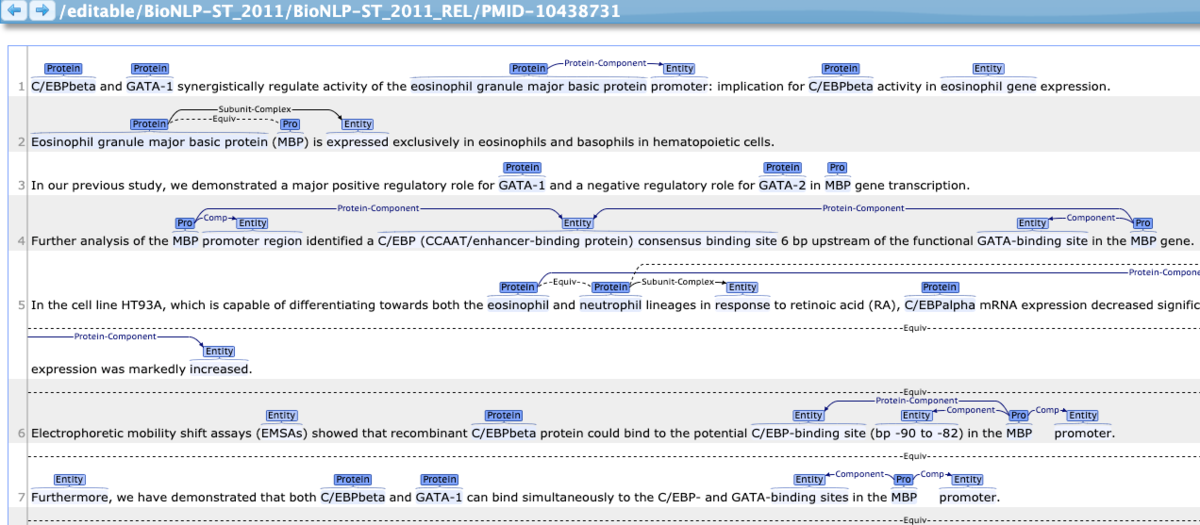

関係抽出はテキスト中に出現する固有表現間にある関係を予測するタスクとなっている。たとえば、「バラク・オバマとミシェル・オバマはXX年に結婚した」というテキストがあったとする。その場合、固有表現として「バラク・オバマ」と「ミシェル・オバマ」、その間の関係としては「夫婦」を予測するといった具合になる。以下に関係抽出の例を示した。

文書分類についてはご存知だと思うので割愛して、推論について説明する。推論というのは、与えられた前提(Premise)の元で仮説(Hypothesis)が正しい(entailment)か否(contradiction)かを判断するタスクとなっている。イメージを掴むために以下に例を示した。正しいか否か以外にどちらとも言えない(neutral)が含まれることもある。

| ラベル | 前提 | 仮説 |

|---|---|---|

| contradiction | ある東アジアの国で、ある男が制服を検査している。 | ある男は眠っている。 |

| neutral | 年配の男と若い男が笑っている。 | 二人の男が笑みを浮かべて、床で遊ぶ猫を笑っている。 |

| entailment | 男たちがサッカーで遊んでいる。 | 男たちがスポーツをしている。 |

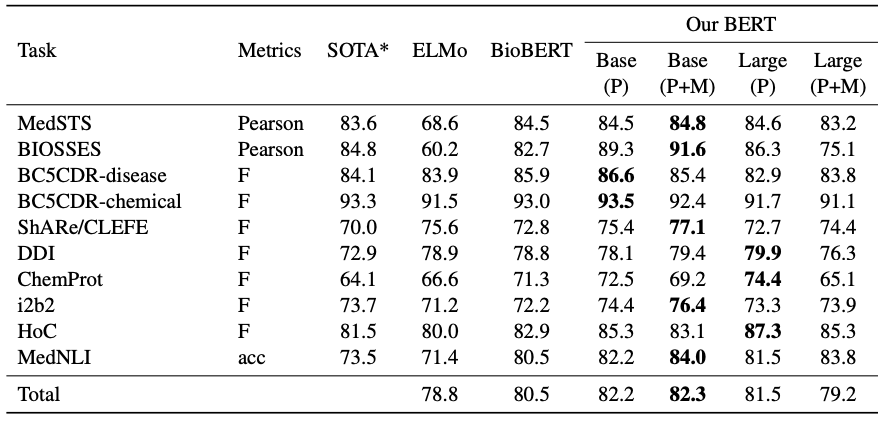

実験ではBERTとELMoを使ったモデルを使って、10種類のデータセットに対する性能を測定している。BERTの事前学習は、医学・生物学文献データベースであるPubMedから論文のアブストラクトを抽出したテキストと健康関連のデータベースであるMIMIC-Ⅲを使って行っている。ELMoの方はPubMedを使っている。実験結果は以下の表の通り。

結果を見ると、すべてのタスクにおいてBERTを事前学習したモデルが最高性能(SOTA)を出していることがわかる。特にBERTのBASEモデルをPubMedとMIMIC-Ⅲのテキストを使って事前学習させたモデルが好成績を収めている。

感想

医療分野の自然言語処理ってどういうタスクが行われていて、現状どのくらいの性能が出ているのが気になっているときに見つけた論文。ちょうどこの論文ではよく使われるデータセットに対してSOTAを出していたので、ジャストミートな論文であった。多くのタスクで実用できそうな性能を出していることがわかったので、今後はこれらを使ってどのような問題を解決できるかに絞って調査すればよさそうである。