BERTで日本語の含意関係認識をする

含意関係認識(Recognizing Textual Entailment: RTE)とは、2つの文1と文2が与えられたときに、文1が正しいとしたら文2も正しいか否かを判定するタスクのことです。たとえば、文1として「太郎は人間だ。」という文があるとします。この文が正しいとしたとき文2である「太郎は動物だ。」が正しいか否かを判定します。この場合は人間は動物であるため正しいと判定する必要があります。

含意関係認識を解くための手法は様々ありますが、本記事ではBERTを使った機械学習ベースの手法で解くことにします。

BERTによる含意関係認識器の実装

本節ではBERTを用いた含意関係認識のモデルを構築します。実装の手順は以下の通りです。

- プロジェクト構成

- パッケージのインストール

- データセットの準備

- モデルの定義

- 評価用コードの実装

- モデルの学習と評価

プロジェクト構成

本節では以下のプロジェクト構成で実装を進めていきます。

. ├── data │ └── entail_evaluation_set.txt ├── models/ ├── models.py ├── preprocessing.py ├── train.py └── utils.py

dataディレクトリの中には使用するデータセットを格納しておきます。今回の場合は次の節で説明する日本語の含意関係認識用データを利用します。modelsディレクトリには学習したモデルを格納します。models.pyには機械学習モデルの定義を行います。preprocessing.pyには前処理用の関数を、train.pyには学習用のコードを、utils.pyにはデータ読込用の関数などを書きます。

パッケージのインストール

まずはBERTを使ったモデルを楽に実装するためにTransformersというパッケージをインストールします。Transformersは自然言語処理向けのモデルが多数含まれたパッケージであり、その中にはBERTも含まれています。BERTは公式の実装も存在するのですが、Transformersを使ったほうが実装が簡単なので、今回はこちらを使います。その他、MeCabのPythonバインディング、TensorFlow、scikit-learn、pandasもインストールします。以下のコマンドを実行しましょう。

$ pip install transformers tensorflow scikit-learn pandas mecab-python3

データの準備

まずはデータセットのダウンロードを行いましょう。今回は京都大学の黒橋・河原研究室で公開しているTextual Entailment評価データを使います。このデータセットは約2700のデータ数からなり、それぞれに4値の推論判定が付与されています。Textual Entailment 評価データからダウンロードしてdataディレクトリに格納しましょう。

データセットをダウンロードして中身を見ると、以下のように空白区切りで情報が格納されています。全部で5カラムから構成され、1カラム目にID、2カラム目にカテゴリとサブカテゴリ、3カラム目に推論判定、4カラム目にテキスト、5カラム目に仮説が格納されています。また、1文ごとに空行が挟まれていることを確認できます。

15 語彙(体言):下位→上位 ◎ あの人は呼吸器専門医だ。 あの人は医者だ。

データセットを用意して形式を確認したので、読み込むための関数load_datasetをutils.pyに書いていきます。ファイルをpandasで読み込んだあと、ラベルのマッピングをし、文のペアとラベルのリストを返しています。マッピングをしているのは、△や○のデータを分類するのが難しいためです。

import pandas as pd def load_dataset(filepath, encoding='utf-8'): df = pd.read_csv(filepath, encoding=encoding, delim_whitespace=True, names=['id', 'cat', 'label', 't1', 't2']) mapping = { '×': '×', '△': '×', '○': '◎', '◎': '◎' } df.label = df.label.map(mapping) return list(zip(df.t1, df.t2)), df.label

データセットを読み込むための関数を書き終わったので、次はデータセットの前処理用の関数をpreprocessing.pyに書いていきます。ここで行う前処理は、ボキャブラリの作成、単語分割、単語のID化、パディングです。まずはボキャブラリを表すクラスVocabを書きます。

import json import numpy as np from tensorflow.keras.preprocessing.sequence import pad_sequences class Vocab: def __init__(self): self.token_index = {} self.index_token = {} def fit(self, labels): self.token_index = {label: i for i, label in enumerate(set(labels))} self.index_token = {v: k for k, v in self.token_index.items()} return self def encode(self, labels): label_ids = [self.token_index.get(label) for label in labels] return label_ids def decode(self, label_ids): labels = [self.index_token.get(label_id) for label_id in label_ids] return labels @property def size(self): """Return vocabulary size.""" return len(self.token_index) def save(self, file_path): with open(file_path, 'w') as f: config = { 'token_index': self.token_index, 'index_token': self.index_token } f.write(json.dumps(config)) @classmethod def load(cls, file_path): with open(file_path) as f: config = json.load(f) vocab = cls() vocab.token_index = config.token_index vocab.index_token = config.index_token return vocab

ボキャブラリを表すクラスを書き終わったら、データセット前処理用の関数をpreprocessing.pyに書きます。やっていることは、テキストを単語分割してID化したあと、パディングしているだけです。

def convert_examples_to_features(x, y, vocab, max_seq_length, tokenizer): features = { 'input_ids': [], 'attention_mask': [], 'token_type_ids': [], 'label_ids': np.asarray(vocab.encode(y)) } for pairs in x: tokens = [tokenizer.cls_token] token_type_ids = [] for i, sent in enumerate(pairs): word_tokens = tokenizer.tokenize(sent) tokens.extend(word_tokens) tokens += [tokenizer.sep_token] len_sent = len(word_tokens) + 1 token_type_ids += [i] * len_sent input_ids = tokenizer.convert_tokens_to_ids(tokens) attention_mask = [1] * len(input_ids) features['input_ids'].append(input_ids) features['attention_mask'].append(attention_mask) features['token_type_ids'].append(token_type_ids) for name in ['input_ids', 'attention_mask', 'token_type_ids']: features[name] = pad_sequences(features[name], padding='post', maxlen=max_seq_length) x = [features['input_ids'], features['attention_mask'], features['token_type_ids']] y = features['label_ids'] return x, y

以上でデータセットを準備するために使う関数の定義は終わりました。次はモデルを作成していきましょう。

モデルの定義

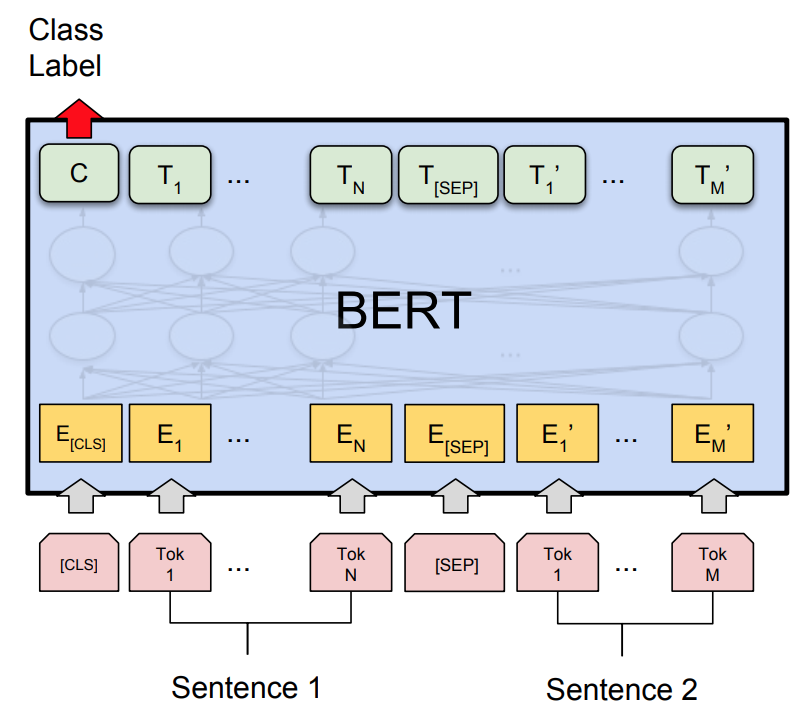

今回実装するモデルのアーキテクチャは以下の図のようになります。用意した3つの入力をBERTに入力し、分散表現に変換します。その後、分散表現を活性化関数にソフトマックス関数を指定した全結合層に入力し、各ラベルの確率を予測します。

モデルの定義は以下のようになります。Transformersを使うととてもシンプルに実装できます。models.pyに追記してください。

import tensorflow as tf from transformers import BertConfig, TFBertForSequenceClassification def build_model(pretrained_model_name_or_path, num_labels): config = BertConfig.from_pretrained( pretrained_model_name_or_path, num_labels=num_labels ) model = TFBertForSequenceClassification.from_pretrained( pretrained_model_name_or_path, config=config ) model.layers[-1].activation = tf.keras.activations.softmax return model

以上でモデルの実装は完了です。次は学習したモデルの評価を行うコードを書いていきます。

評価用コードの実装

学習したモデルを使って評価をする関数を作成していきましょう。以下のevaluateクラスをutils.pyに書いていきます。このクラスでは、predictメソッドに(input_ids, attention_mask, token_type_ids)を与えると、予測結果を返してくれます。処理の流れとしては、前処理したデータに対してpredictメソッドで予測を行った後、np.argmaxで確率値の最も高いラベルのIDを取得し、decodeメソッドで文字列に変換しています。そして最後に、評価を行っています。

import numpy as np from sklearn.metrics import classification_report def evaluate(model, target_vocab, features, labels): label_ids = model.predict(features) label_ids = np.argmax(label_ids, axis=-1) y_pred = target_vocab.decode(label_ids) y_true = target_vocab.decode(labels) print(classification_report(y_true, y_pred, digits=4))

モデルの学習と評価

では最後に、これまでに説明した内容に基づいて、モデルを学習させて性能を評価するコードを書いていきましょう。以下のコードをtrain.pyに書いて保存します。

from sklearn.model_selection import train_test_split from tensorflow.keras.callbacks import EarlyStopping from transformers import BertJapaneseTokenizer from models import build_model from preprocessing import convert_examples_to_features, Vocab from utils import load_dataset, evaluate def main(): # Set hyper-parameters. batch_size = 32 epochs = 100 model_path = 'models/' pretrained_model_name_or_path = 'bert-base-japanese-whole-word-masking' maxlen = 250 # Data loading. x, y = load_dataset('./data/entail_evaluation_set.txt') tokenizer = BertJapaneseTokenizer.from_pretrained(pretrained_model_name_or_path) # Pre-processing. x_train, x_test, y_train, y_test = train_test_split(x, y, test_size=0.2, random_state=42) target_vocab = Vocab().fit(y_train) features_train, labels_train = convert_examples_to_features( x_train, y_train, target_vocab, max_seq_length=maxlen, tokenizer=tokenizer ) features_test, labels_test = convert_examples_to_features( x_test, y_test, target_vocab, max_seq_length=maxlen, tokenizer=tokenizer ) # Build model. model = build_model(pretrained_model_name_or_path, target_vocab.size) model.compile(optimizer='sgd', loss='sparse_categorical_crossentropy') # Preparing callbacks. callbacks = [ EarlyStopping(patience=3), ] # Train the model. model.fit(x=features_train, y=labels_train, batch_size=batch_size, epochs=epochs, validation_split=0.1, callbacks=callbacks) model.save_pretrained(model_path) # Evaluation. evaluate(model, target_vocab, features_test, labels_test) if __name__ == '__main__': main()

コードを書き終えたら実行してみましょう。BERTは大きなモデルなのでCPU上で実行するととても時間がかかります。できればGPU上で実行させることをおすすめします。参考までにGPU(NVIDIA Tesla V100)上で学習させたところ、1エポックに30程度かかり、全体としては200秒程度かかりました。性能としては正解率で0.6485という結果になりました。

Epoch 1/100 1779/1779 [==============================] - 50s 28ms/sample - loss: 0.6683 - val_loss: 0.6361 Epoch 2/100 1779/1779 [==============================] - 30s 17ms/sample - loss: 0.6442 - val_loss: 0.6549 Epoch 3/100 1779/1779 [==============================] - 30s 17ms/sample - loss: 0.6193 - val_loss: 0.6223 Epoch 4/100 1779/1779 [==============================] - 30s 17ms/sample - loss: 0.5913 - val_loss: 0.6282 Epoch 5/100 1779/1779 [==============================] - 30s 17ms/sample - loss: 0.5603 - val_loss: 0.7203 Epoch 6/100 1779/1779 [==============================] - 30s 17ms/sample - loss: 0.5252 - val_loss: 0.6349 precision recall f1-score support × 0.4771 0.4371 0.4562 167 ◎ 0.7251 0.7561 0.7403 328 accuracy 0.6485 495 macro avg 0.6011 0.5966 0.5983 495 weighted avg 0.6415 0.6485 0.6445 495

以上で実装は完了です。 今回はモデルもコードもシンプルさを重視して書いてみました。 最も基礎的なモデルなので性能はそれほど出ませんが、その分、改善の余地は大きいです。色々試してみてください。